OpenAI近日震撼發布了兩款全新AI模型——o3與o4-mini,這兩款模型被譽為OpenAI有史以來最強大、最智能的創作。它們不僅在技術上實現了飛躍,更在功能和應用上開啟了新的篇章。

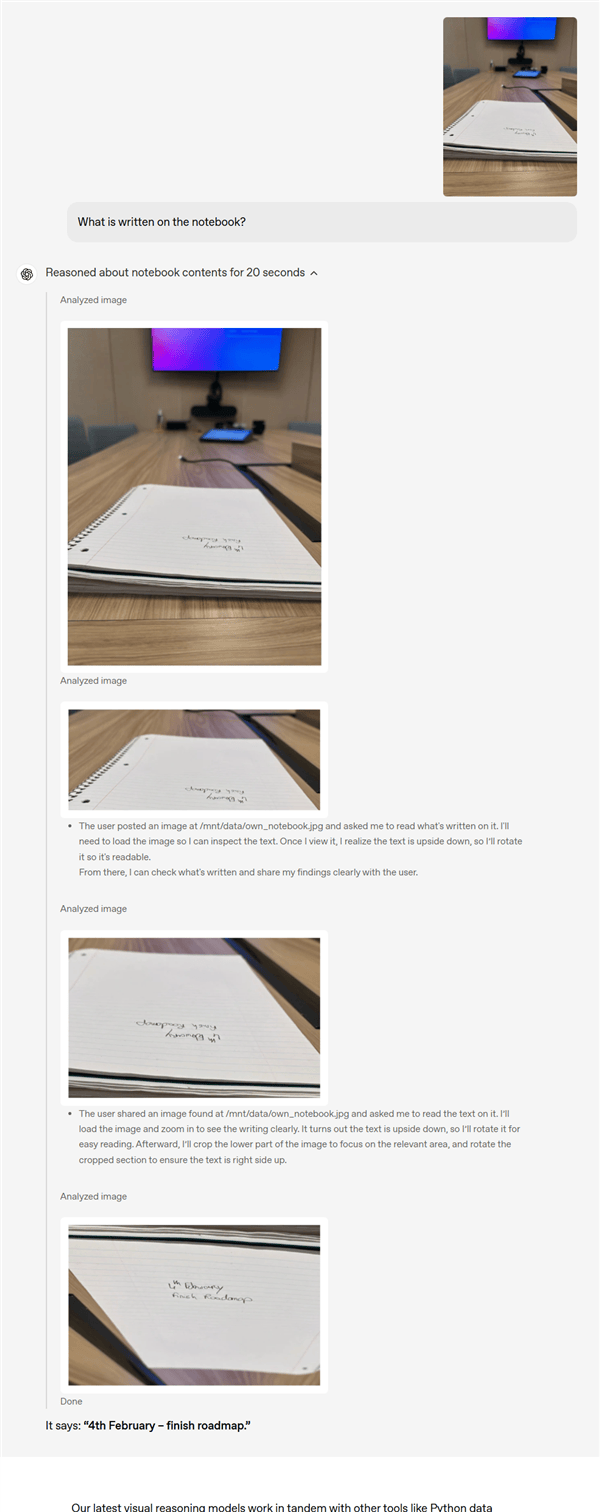

與前代產品相比,o3與o4-mini的最大亮點在于它們首次擁有了真正的視覺推理能力。這意味著,這兩款模型不僅能看圖識圖,更能基于圖像內容進行深度思考和分析。這一突破性的進展,無疑將AI在視覺領域的應用推向了一個新的高度。

更令人驚嘆的是,o3與o4-mini還具備了跨模態處理能力。它們能夠同時處理文本、圖像和音頻等多種類型的數據,并作為智能體(Agent)自動調用網絡搜索、圖像生成、代碼解析等工具,以及進入深度思考模式。這種全方位的處理能力,使得這兩款模型在應對復雜任務時更加游刃有余。

為了訓練o3與o4-mini如何使用這些工具,OpenAI采用了強化學習的方法。經過大量的訓練和實踐,這兩款模型不僅學會了如何正確地使用工具,還能夠在合適的時機以正確的格式快速生成可靠的答案。這一能力的獲得,無疑將極大地提升AI在實際應用中的效率和準確性。

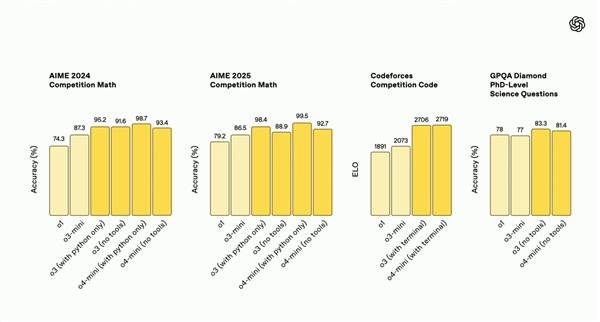

在實際測試中,o3與o4-mini的表現同樣令人矚目。在AIME 2024數學競賽題目中,它們的準確率分別達到了91.6%和93.4%,遠超前代o1的74.3%。而在AIME 2025題目中,這兩款模型的準確率也分別達到了88.9%和92.7%。在Codeforces編程競賽評分中,支持終端工具的o3和o4-mini分別取得了2706和2719的ELO分數,同樣領先于其他前輩模型。

為了讓更多的用戶能夠體驗到這兩款強大的模型,OpenAI宣布,即日起,ChatGPT的Plus、Pro會員以及Team用戶將可以直接使用o3、o4-mini以及更高版本的o4-mini-high。這一舉措無疑將極大地推動AI技術的普及和應用。

總的來說,o3與o4-mini的發布標志著OpenAI在AI技術上的又一次重大突破。這兩款模型不僅擁有強大的視覺推理能力和跨模態處理能力,還在實際應用中表現出了極高的準確性和效率。隨著它們的廣泛應用和推廣,我們有理由相信,AI技術將在未來發揮更加重要的作用。