微軟近期在人工智能領(lǐng)域再次邁出重要一步,推出了OmniParser V2.0,這是一款基于純視覺技術(shù)的GUI智能體解析工具,能夠精準(zhǔn)識別并解析屏幕上的可交互圖標(biāo)。此前,該工具與GPT-4V的結(jié)合已顯著提升了其識別能力。

在2月12日,微軟官方網(wǎng)站上正式發(fā)布了OmniParser的最新版本。這一版本不僅延續(xù)了前代產(chǎn)品的優(yōu)勢,還實(shí)現(xiàn)了與多個先進(jìn)AI模型的兼容,包括OpenAI的多個版本(4o、o1、o3-mini)、DeepSeek R1、Qwen 2.5VL以及Anthropic的Sonnet等。這意味著這些模型在OmniParser的助力下,能夠轉(zhuǎn)變?yōu)椴倏赜嬎銠C(jī)的AI智能體。

相較于V1版本,OmniParser V2.0在訓(xùn)練數(shù)據(jù)上進(jìn)行了大幅升級,采用了更大規(guī)模的交互元素檢測數(shù)據(jù)和圖標(biāo)功能標(biāo)題數(shù)據(jù)。這一改進(jìn)使得V2.0在檢測較小的可交互UI元素時,準(zhǔn)確率有了顯著提升,同時推理速度也更快,延遲降低了60%。

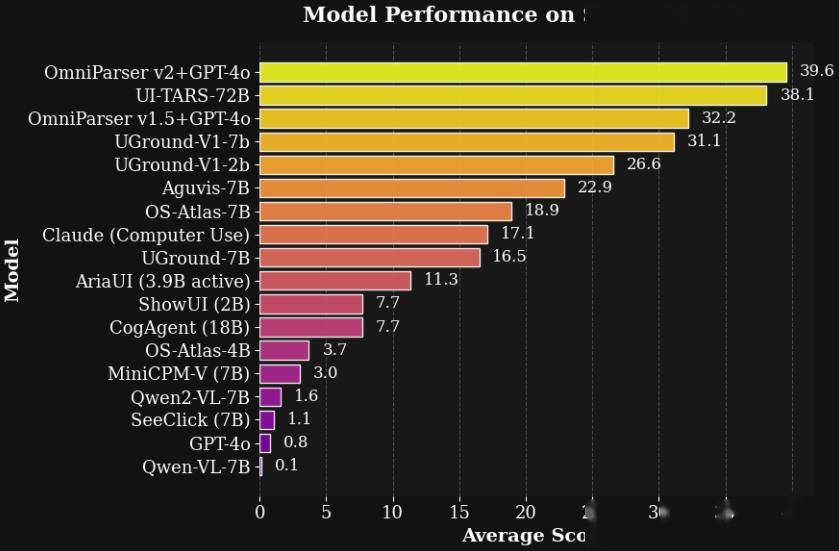

在高分辨率Agent基準(zhǔn)測試ScreenSpot Pro中,OmniParser V2.0與GPT-4o的結(jié)合展現(xiàn)出了驚人的效果。測試結(jié)果顯示,V2.0+GPT-4o的準(zhǔn)確率高達(dá)39.6%,而GPT-4o單獨(dú)使用時,準(zhǔn)確率僅為0.8%。這一對比充分展示了OmniParser V2.0在提升AI模型性能方面的巨大潛力。

為了加速不同智能體設(shè)置的實(shí)驗進(jìn)程,微軟還推出了OmniTool這一開源工具。OmniTool是一個集成了屏幕理解、定位、動作規(guī)劃和執(zhí)行等基本功能的Docker化Windows系統(tǒng)。這一工具為將大模型轉(zhuǎn)變?yōu)橹悄荏w提供了關(guān)鍵支持,極大地簡化了實(shí)驗過程。

對于對OmniParser和OmniTool感興趣的開發(fā)者而言,微軟已經(jīng)提供了開源地址,方便他們獲取并使用這些工具,以進(jìn)一步推動人工智能技術(shù)的發(fā)展。