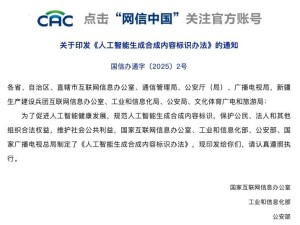

近期,中國針對人工智能技術的快速發展及其帶來的潛在風險,正式推出了《人工智能生成合成內容表示辦法》。這一舉措緊隨雷軍對AI換臉和AI擬聲技術的公開關注,標志著中國在AI治理領域邁出了重要一步。

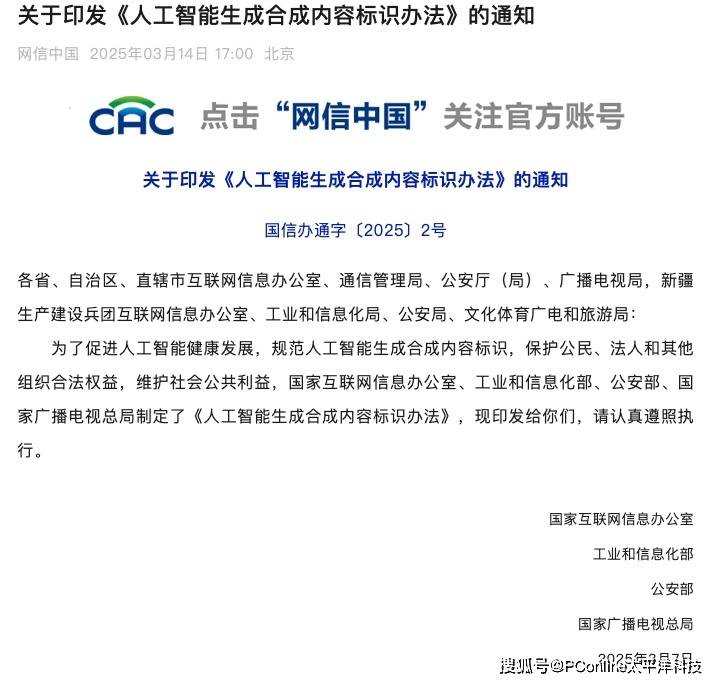

隨著AI技術的廣泛應用,市場上已涌現出超過300款生成式AI產品和3000多個生成合成服務。然而,技術的濫用也引發了社會對虛假信息傳播和身份冒充等問題的擔憂,導致信任危機。為此,國家網信辦等四部門聯合發布的《辦法》,旨在通過“技術標準+管理制度”的雙重模式,強化AI治理,確保技術的健康發展。

《辦法》中的一大亮點是引入了顯式標識和隱式標識的雙軌機制。顯式標識要求AI生成的內容以直觀的方式,如視頻水印、文本標注等,明確告知用戶其身份。而隱式標識則通過數字水印、元數據嵌入等技術,在文件底層添加不可見的“身份證”,為監管部門提供溯源依據。

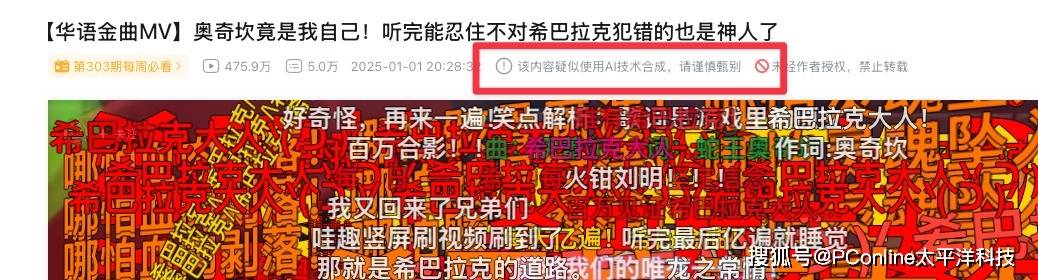

對于內容發布平臺而言,《辦法》同樣提出了嚴格要求。平臺需自動檢測并標識上傳的內容,對未標識的內容添加顯著提示。同時,平臺還需提供標識工具,引導創作者主動聲明內容的AI生成屬性。對于申請無顯式標識的用戶,平臺需對其身份和使用記錄至少保留6個月,以實現從源頭防控技術濫用。

《辦法》還對用戶(創作者)設定了明確的規范。使用AI生成的內容必須主動標識,且標識不得刪除、偽造或隱匿。一旦違反規定,將依據相關法律法規追究責任。這一舉措旨在確保AI生成內容的真實性和可信度,維護社會信任。