聯(lián)想今日宣布,其首款采用AMD技術(shù)的AI大模型訓(xùn)練服務(wù)器——聯(lián)想問天WA7785a G3,在單機(jī)部署671B(即滿血版)DeepSeek大模型時(shí),成功實(shí)現(xiàn)了6708 token/s的極限吞吐量,刷新了單臺(tái)服務(wù)器運(yùn)行大模型的性能記錄。這一成就不僅彰顯了聯(lián)想在AI基礎(chǔ)設(shè)施領(lǐng)域的深厚技術(shù)積累和快速研發(fā)響應(yīng)能力,更在AI算力競(jìng)爭(zhēng)日益激烈的當(dāng)下,以卓越的技術(shù)實(shí)力樹立了新的行業(yè)標(biāo)桿。

聯(lián)想問天WA7785a G3服務(wù)器之所以能夠達(dá)到如此高的性能,得益于聯(lián)想萬全異構(gòu)智算平臺(tái)的強(qiáng)大支持。該平臺(tái)通過一系列創(chuàng)新手段,如訪存優(yōu)化、顯存優(yōu)化、PCIe 5.0全互聯(lián)架構(gòu)創(chuàng)新以及精選SGLang框架中性能最優(yōu)的算子,對(duì)大模型從預(yù)訓(xùn)練到推理的全過程進(jìn)行了深度優(yōu)化。在實(shí)測(cè)中,該服務(wù)器在部署DeepSeek 671B大模型時(shí),最高吞吐量達(dá)到了6708 token/s。

在具體應(yīng)用場(chǎng)景中,聯(lián)想問天WA7785a G3同樣表現(xiàn)出色。在模擬問題對(duì)話場(chǎng)景(上下文序列長(zhǎng)度分別為128和1K)時(shí),該服務(wù)器最高可支持158個(gè)并發(fā)用戶,TPOT為93毫秒,TTFT為2.01秒。而在模擬代碼生成場(chǎng)景(上下文序列長(zhǎng)度分別為512和4K)時(shí),并發(fā)數(shù)可達(dá)140,TPOT為100毫秒,TTFT為5.53秒。這一性能水平意味著,單臺(tái)聯(lián)想問天WA7785a G3服務(wù)器足以支撐1500人規(guī)模企業(yè)的正常使用。

此次性能突破的背后,是聯(lián)想中國(guó)基礎(chǔ)設(shè)施業(yè)務(wù)群、聯(lián)想研究院ICI實(shí)驗(yàn)室與AMD的深度合作與協(xié)同調(diào)優(yōu)。雙方聯(lián)合設(shè)計(jì)、共同實(shí)現(xiàn)了這一突破,并仍在持續(xù)探索深度調(diào)優(yōu)的新方法,以期實(shí)現(xiàn)更高的性能突破。這一合作不僅體現(xiàn)了聯(lián)想與AMD在技術(shù)創(chuàng)新上的緊密合作,更展示了雙方在AI算力領(lǐng)域的領(lǐng)先地位。

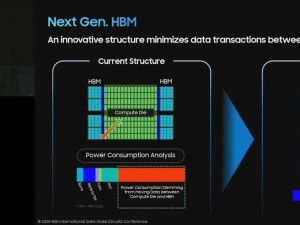

聯(lián)想問天WA7785a G3服務(wù)器的卓越性能,離不開其硬核的硬件配置。該服務(wù)器搭載了2顆AMD處理器和8顆AMD新一代Instinct OAM GPU,這些強(qiáng)大的算力引擎為大模型訓(xùn)練、推理等場(chǎng)景提供了堅(jiān)實(shí)的支持。同時(shí),WA7785a G3還擁有超大的顯存容量,單顆GPU的HBM3e顯存容量高達(dá)192GB,總計(jì)達(dá)1.5TB。這一超大顯存使得單機(jī)在支持全量模型推理時(shí),仍能保持充足的KV緩存空間,滿足大模型并行計(jì)算時(shí)對(duì)跨節(jié)點(diǎn)通信的高帶寬需求。

聯(lián)想問天WA7785a G3的獨(dú)特架構(gòu)設(shè)計(jì)也為其卓越性能提供了有力保障。該服務(wù)器采用三重獨(dú)立風(fēng)道設(shè)計(jì),分別針對(duì)CPU節(jié)點(diǎn)、GPU節(jié)點(diǎn)和交換機(jī)節(jié)點(diǎn)進(jìn)行精準(zhǔn)散熱控制,提高了散熱效率,確保了服務(wù)器的穩(wěn)定性和可靠性。這一設(shè)計(jì)不僅有助于最大程度地釋放算力潛能,還突破了帶寬限制,使得聯(lián)想問天WA7785a G3成為用戶首選的大模型推理服務(wù)器。