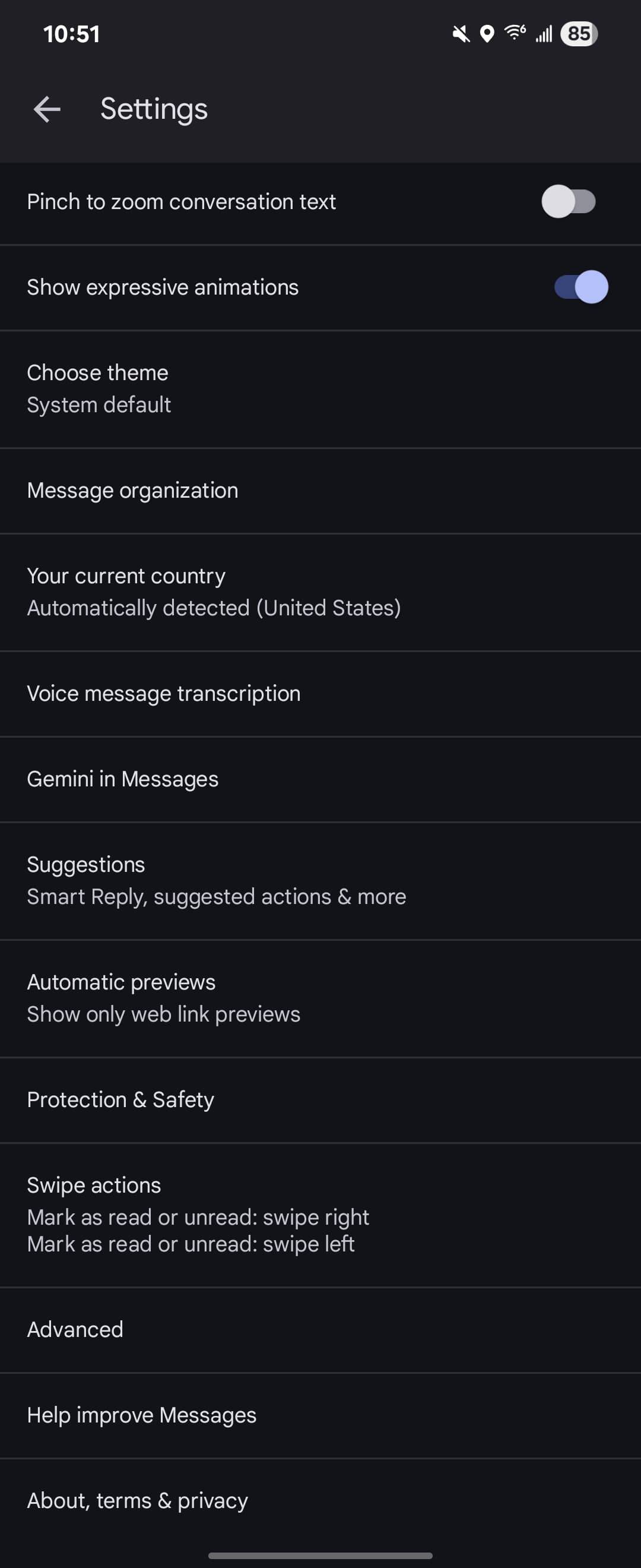

近期,據外媒9To5Google報道,谷歌信息App正針對部分用戶測試一項名為“敏感內容警告”的新功能。此功能借助AI技術,能在用戶發送或接收消息時自動識別并處理包含敏感內容的圖片。

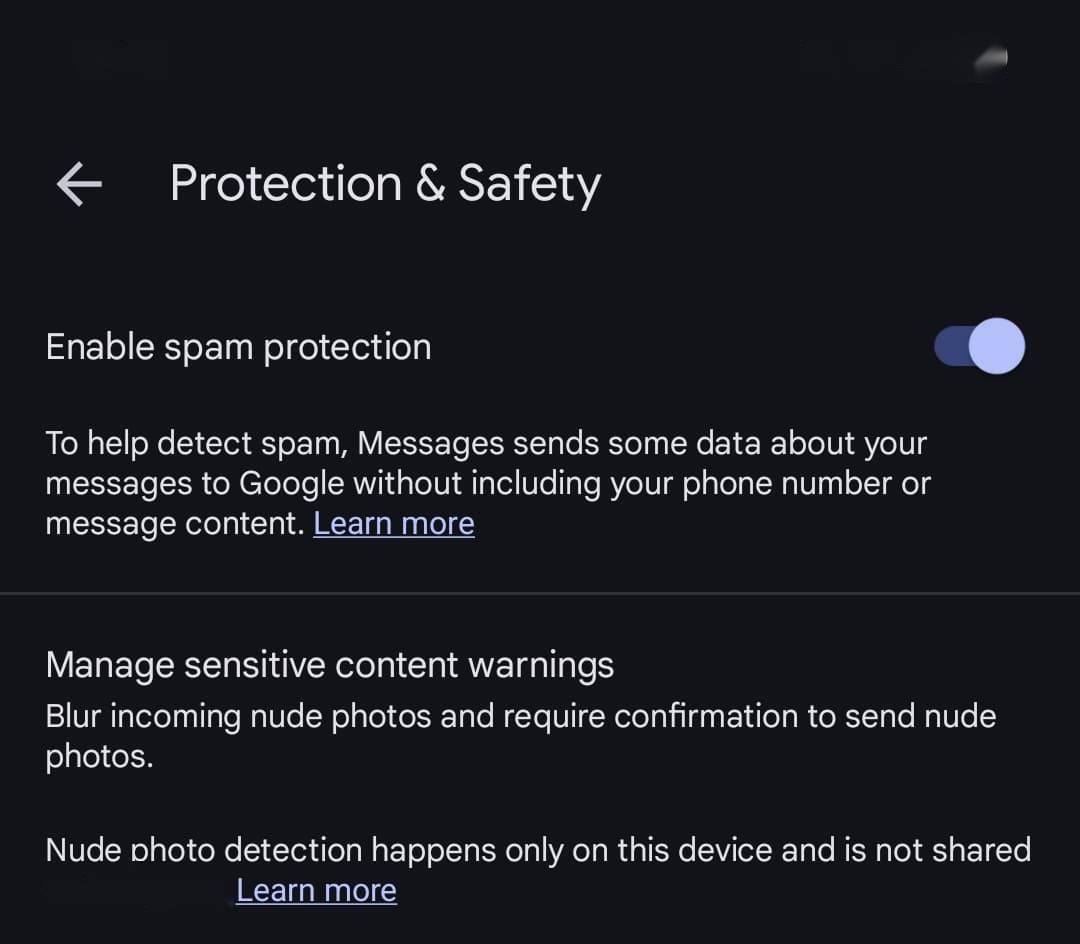

具體而言,當該功能啟用后,用戶在接收圖片消息時,App會即時檢測圖片內容。一旦識別到圖片中包含敏感元素,系統將自動對圖片進行模糊處理。用戶需通過二次確認,選擇“查看原圖”或“刪除”。用戶還擁有一鍵屏蔽發送者的選項,以增強信息安全性。

在發送或轉發圖片消息時,如果圖片被判定為包含敏感內容,系統會立即彈出風險提醒。用戶需手動確認后,方可繼續發送。這一機制旨在預防不當內容的傳播,保護用戶的隱私和安全。

谷歌方面表示,該功能采用Android System SafetyCore的本地AI技術,確保在識別敏感內容時,不會將任何圖像數據上傳至谷歌服務器,從而保護用戶的隱私。

對于未成年人用戶,該功能默認開啟。若家長通過Family Link應用監管孩子賬戶,將能夠控制此功能的設置。非家長監管的未成年人賬戶,以及成年人賬戶,該功能則默認關閉,用戶可根據需要手動開啟。

目前,該功能仍處于測試階段,尚未公布正式推送的時間表。據9To5Google報道,他們在多臺設備上更新了谷歌信息App,但僅在兩臺設備上收到了該功能的推送。